在各種專案中,我發現一個重要的區分線:AI擅長於拆解流程並提供最佳化路徑,作為有效的決策輔助工具。但「要不要做」則涉及價值取捨與風險承擔,這是人類獨有的責任。特別是在台灣企業的背景下,生成式AI不僅提升了效率和洞見,也挑戰了決策倫理。

從半導體到電商、金融到醫療,各行業都在採用演算法和自動化技術。台灣的個資保護法、金管會的規範,以及醫療法規與醫療器材管理辦法,都在形成監管框架。我必須確保模型和流程能夠被解釋、稽核,並與社會價值如公平、透明、可信等對齊。

這份教學基於我的實務經驗,結合可解釋的AI、資料治理、合規與人機協作,提供具體的框架。目標是幫助管理者、產品經理、資料科學家與合規人員,在追求績效的同時,保持決策主權,降低風險,保護品牌信譽。

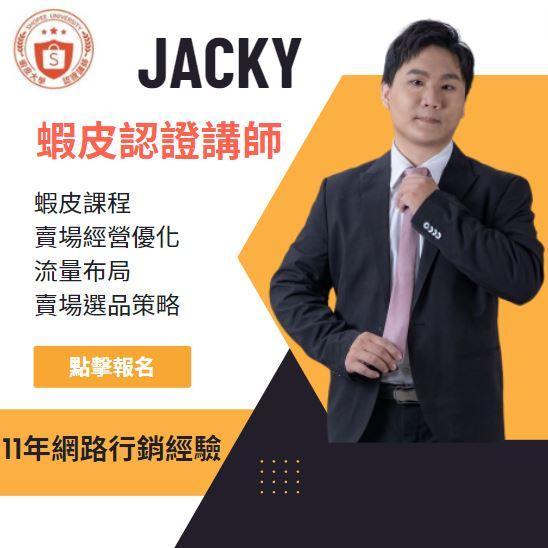

🚀 讓新手 7 天找到爆品的 AI 選品秘笈?

近兩年蝦皮競爭越來越激烈,你是不是也遇過這些狀況?

-

上架 10 個商品,只有 1 個有流量

-

明明是同款商品,別人賣爆,你卻一整天無人問津

-

工具很多,但沒有一套「確定可以找到爆品」的方法

-

找資料找到懷疑人生,最後上架時市場早就變了

如果你有這些困擾,其實不是你不會選品,

而是——你少了一套「AI 幫你做市場分析」的流程。

💥【真實案例】

小白新手靠一組 Prompt,14 天衝到日單 30+

一位剛從上班族轉做副業的新手賣家,

原本每天只有零星訂單,流量也幾乎是 0。

我給他使用《選品 Prompt 套組》的部分內容:

-

使用 Prompt 1 找出「最近 30 天暴漲關鍵字」

-

用 Prompt 4 挖市場需求(什麼人在找、為什麼找)

-

用 Prompt 6 逆向拆解競品 listing(找對手弱點)

-

用 Prompt 11 生出最強 SEO 商品標題+五點賣點

結果非常誇張:

-

🔥 上架第 3 天進入分類熱門

-

🔥 14 天衝到 1,200+ 瀏覽量

-

🔥 一款商品直接爆起來

-

🔥 廣告費從「每天燒 500」→「自然流量穩定曝光」

AI 的敏捷度,遠遠超過你肉眼手動分析數據的速度。

當別人在「試錯」,

你用 Prompt 就可以直接「挑中高需求、低競爭的商品」。

📦 你下載後會拿到什麼?

🎯 完整 16 組高轉換選品 Prompt

包含:

-

市場趨勢搜尋語(快速找爆品方向)

-

競品拆解框架(找出對手弱點)

-

蝦皮 SEO 標題產生器

-

五點描述生成器(提升 CTR & CVR)

-

商品圖腳本(給 AI/攝影用)

-

爆品模型:Zero Competition 法(低競爭切入)

這套懶人包的精神很簡單:

👉 **讓 AI 自動幫你選品、寫文案、挖缺口,你只需要:

「複製 → 貼上 → 上架」

你不需要行銷背景、也不用懂數據,

只要照著 Prompt 走,

就能比 90% 的新手更快找到第一款爆品。

加 LINE 免費拿《全套 16 組 Prompt 免費送你》輸入關鍵字 (蝦皮電商選品AI指令) → 點我領取

我將透過清晰、操作性的步驟,解釋「怎麼做」的合理範圍與「要不要做」的關鍵門檻。當生成式AI提供精準建議時,我會考慮合規、風險、利害關係人影響做出最終判斷,並留下審計軌跡以接受檢視。

重點摘要

- AI與人工智慧擅長程序與優化,但最終的「要不要做」需由人承擔責任。

- 台灣企業導入生成式AI時,需同時滿足決策倫理與監理要求。

- 半導體、電商、金融、醫療情境下,合規與資料治理是基本盤。

- 決策輔助工具必須可解釋、可稽核,並保留人工覆核權限。

- 以風險、合規、社會價值為門檻,維持決策主權與長期信任。

- 建立跨部門流程,將模型建議轉化為可監控的治理機制。

前言:在台灣情境下重新理解AI與決策的邊界

在台灣市場推動AI專案多年,我常見到團隊把模型分數當作唯一標準。這種做法忽視了公司治理、風險管理和法規的重要性。因此,我想先解釋一下:AI能提供多種路徑,但最終的決策仍需人類負責。

為何我寫下這份教學與觀點

我曾多次見到模型建議被誤解為命令,結果導致個資保護與合規問題。台灣市場具有一定的產業結構與監管文化。如果不清楚決策邊界,AI反而可能增加風險管理的挑戰。我希望透過實用的方法,幫助團隊將技術能力與公司治理相結合。

「怎麼做」與「要不要做」的核心差異

「怎麼做」主要關於方法和程序,如出價最佳化、推薦排序和流程自動化。這是AI的強項,能快速找到高機率的可行解。

「要不要做」則關乎價值和責任,如是否犧牲隱私以求短期利潤,或是否採用高風險策略。這需要結合風險管理、利害關係人期待與公司治理原則,並考慮台灣市場的社會觀感與法規。

讀者可期待學到什麼

- 在地合規要點:個資保護法與與GDPR相容原則,落地流程與審計留痕。

- 可解釋AI方法:如SHAP,讓團隊看懂模型為何這樣建議。

- 人機協作決策:RACI、雙層審核、可撤銷機制與申訴通道。

- 風險矩陣設計:技術、商業、聲譽三軸評估,建立紅線與警戒值。

- 資料治理與偏誤控制:樣本代表性、回饋迴圈與偏見抑制。

- 利害關係人溝通與KPI設定:把AI成果對齊策略目標與決策邊界。

| 面向 | 關鍵問題 | 在台灣市場的重點 | 與公司治理/風險管理的連結 |

|---|---|---|---|

| 合規 | 是否符合個資保護法與GDPR原則 | 資料最小化、目的外利用限制 | 內控條款、稽核證據鏈 |

| 可解釋性 | 能否說清建議來源與影響因子 | 提供簡明可讀報告給決策者 | 決策可追溯、責任可歸屬 |

| 決策流程 | 誰下決定、誰負責任 | RACI角色清晰、雙層審核 | 授權邊界、簽核權限 |

| 風險矩陣 | 技術、商業、聲譽如何量化 | 紅線、警戒值、撤回條件 | 前瞻控管、應變計畫 |

| 資料治理 | 偏誤來源與修正機制 | 樣本代表性與在地語境 | 持續監控、模型更新節奏 |

AI的本質:機率、模式與可解釋性的限制

在專案中,我常告訴團隊:AI 只看資料中的規律,不關心道德或意圖。它依賴於機器學習來從樣本中擬合出模式,使用機率模型和目標函數。當我們討論可解釋性時,實際上是在問模型為何如此,而非它是否應該如此。

從資料到建議:模型如何形成「最佳做法」

模型首先定義任務,然後通過機器學習從大量行為資料中尋找最小化損失或最大化目標的方法。這些演算法依賴於機率模型來估計條件分佈,從而輸出一個統計上更可靠的選擇。

所謂「最佳做法」主要取決於訓練樣本、特徵工程以及評估指標。如果資料偏差或指標設計過於狹隘,建議可能偏向短期利益,可能不合適或不合法。我在檢視結果時會使用可解釋性工具,確認關鍵特徵是否合理,並與商業背景進行交叉比較。

灰箱與黑箱:何時需要人類的價值判斷

深度神經網路屬於黑箱,雖然準確率高,但其可解釋性有限。梯度提升樹等灰箱方法則可以通過特徵重要度和局部解釋來增強可解釋性,讓我們更好地理解輸出對變數的邊際影響。這兩者各有其優勢,但都不能取代人類的決策責任。

當決策涉及到人權、資源分配、公共利益或高風險情況時,我會啟動人工覆核和治理流程。這包括設定警戒值和例外處理。在這些情況下,AI 只提供證據和情境分析,而最終的價值判斷則由我和決策團隊負責。

生成式AI與決策支援系統的定位差異

生成式AI 擅長於生成語言和整合知識,能快速產生草稿、摘要和探索性洞見。但它可能會產生幻覺和來源不確定性。我會要求標註可追溯依據,並使用內部知識庫來約束輸出的一致性。

傳統決策支援系統則專注於結構化資料、規則和優化,結合機率模型和報表管控。實際上,我會使用生成式AI 加速分析,然後交由指標面板和人類審核來決定,保持透明和穩健。

| 面向 | 生成式AI | 傳統決策支援 | 我在專案的用法 |

|---|---|---|---|

| 核心能力 | 自然語言生成、檢索增強、快速總結 | 結構化分析、規則推論、優化求解 | 先以草稿與情境梳理,再由指標驗證 |

| 方法論 | 大規模預訓練、機器學習微調 | 機率模型、統計推斷、線性與整數規劃 | 雙軌並行,交叉檢核假設與數據 |

| 可解釋性 | 有限,需要對話式追問與引用 | 較高,可追溯規則與係數 | 以可解釋性報告做會議輸入 |

| 風險 | 幻覺、來源不確定、一致性波動 | 指標偏誤、規則僵化、過度擬合 | 設置覆核閥值與異常告警 |

| 典型場景 | 內容草擇、客服輔助、研究初稿 | 定價模組、庫存配置、風控評分 | 以洞見啟動,再由決策流程收斂 |

倫理與價值:AI無法替你承擔的選擇後果

我視AI為工具,而非盾牌。當演算法追求效率與成長時,結果的承擔者是我與公司。這是倫理治理的核心:明確目標、界限與問責,避免將外部性轉嫁給社會,同時以企業責任為導向。

價值衝突與外部性:誰來負責

AI最佳化可能放大效率與成長對公平與隱私的拉扯。若模型刺激黏著,卻讓未成年人承擔風險,外部性將落在家庭與公共資源上。責任不在模型供應商,而在採用者與決策者。

我會主動揭露假設與影響面,並記錄決策依據。當提升指標卻壓縮弱勢群體權益時,我以企業責任為先,調整權重與閾值,必要時暫停上線。

風險承擔與利害關係人協調

首先,我會盤點利害關係人:包括客戶、員工、供應商、監理機關與在地社群。接著,我會透過清單化溝通節點,讓每一方了解風險如何分配與緩解。

- 使用者:提供簡明告知、退出選項與可申訴入口。

- 員工:說明AI介入的決策邏輯與責任邊界。

- 監理機關:建立留痕與報備機制,確保可稽核。

我設置高風險情境的「人類覆核」與停機條件,避免技術風險轉化為社會成本。同時,我會將協調結果回饋到模型與流程。

在企業治理中的倫理準則落地

我參考OECD AI原則與EU AI Act動向,結合台灣個資保護法與資通安全規範,制定可操作的內規。這些內規由董事會與高階管理層納入企業風險管理與獎酬設計中。

- 目的限制與資料最小化,降低不當蒐集與濫用。

- 偏誤檢測與可解釋性報告,支撐人類判斷。

- 可申訴渠道、問責與審計,確保持續修正。

當內控與績效並行,我才能在AI導入中穩定維持倫理治理。讓企業責任不僅僅是口號,而是日常的選擇與行動。

AI

首先,我要明確AI的定義。在企業環境中,AI是一套工具與系統的集合。它包含了機器學習、深度學習、自然語言處理和計算機視覺。AI能夠從資料中提取模式,生成或預測結果,並與現有的流程整合,以提升效率和一致性。

這種理解有助於我在引入AI時,清楚劃分能力邊界與決策責任。

在台灣企業的日常運作中,我將AI視為決策輔助工具,而非決策者。它擅長在大量資料中找出關聯、估計機率和優化參數。它還能生成文字和圖像。但當涉及價值取捨、倫理問題和法律風險時,責任歸屬仍然落在人身上。

因此,我要求供應商提供模型文件、資料來源說明和風險揭露。內部則建立監控和覆核機制。

在台灣產業應用中,我常見到四種場景。製造業使用AI來預測良率和偵測異常;電商則利用它來進行推薦和庫存優化。客服自動化和意圖分析,以及金融的詐欺偵測和風險評分,也是常見的應用。

醫療影像輔助判讀也在快速成長,但必須遵守衛生福利部和醫療器材法規。我與法務、資安和內控部門同步評估,以確保個資保護法和公部門資料開放規則的合法使用。

面對能力邊界,我將AI定位為提供證據和建議的來源,而非最終結論。模型可以指出「哪裡可能出錯」和「怎麼調參更快」,但它們不能回答「是否值得冒險」。因此,我以明確的定義、流程權限和責任歸屬來約束行為。

在每一個台灣產業應用的節點,我都會考慮風險、成本和合規性。

用例拆解:當AI能給出「怎麼做」,我仍需自行判斷「要不要做」

我專注於「能做」與「該不該做」的界定。AI 提升效率和行銷最佳化,但我依據台灣的法律和社會期待來制定界限。這樣做是為了保護品牌信任,並確保反歧視原則在流程中得到實施。

行銷投放:轉換率最大化 vs. 品牌長期信任

演算法建議更激進的受眾定向和頻控,以追求最高的轉換率和行銷最佳化。我不採用暗黑模式,也不使用模糊的 Cookie 同意來換取點擊。

我設立了不觸及未成年人的限制,避免對敏感族群進行再行銷。同時,我為創意輪播和曝光次數設置了上限。這樣既能滿足短期轉換需求,又能維護品牌信任,並符合個資保護規範。

定價策略:即時動態定價 vs. 公平與合規

動態定價讓供需變化實時反映,如航班和共享乘車在高峰期能降低需求。但若加價過高,可能引發民眾不滿和政策風險。

我採用透明的規則,明確告知價格變動的因素,並在高峰期加成設置上限,以避免差別待遇問題。這樣做符合公平交易法和消費者保護法,AI 只作為參考,而非決策。

人資篩選:效率提升 vs. 歧視風險

HR科技可以加快履歷分析和預篩,但我先移除性別、年齡、學校等變數。然後,使用差別影響比率(80% rule)檢測偏差,確保反歧視。

我保留人工審核和申訴渠道,並以勞動基準法和就業服務法為準則。AI 協助排序,但最終決策由我負責,以保護人才體驗和品牌信任。

決策框架:我如何界定AI建議的使用邊界

我將 AI 视为放大镜,而非方向盘。为确保在台湾的公司治理中稳健落地,我制定了一套可执行的决策框架。该框架使得建议可以被量化、审视和追踪。它与 KPI 和风险矩阵相互对齐。

目标清晰化:可量化指标与不可量化价值

首先,我将目标分为两类。可量化指标包括营收、留存、成本和时效,它们直接与 KPI 相关联。不可量化价值则包括公平、隐私、品牌价值和合规,这些是公司治理的基本底线。

通过对这两类目标的综合评估,AI 只能提供“如何做”的建议。但是,是否采用这些建议,取决于对这两类价值的权衡和取舍。

决策分层:策略、战术、操作的分工

在策略层,我定义了不做清单和红线,以避免目标漂移。战术层,我设置了配额、建立受控实验和下线条件,以确保 KPI 与长期价值的平衡。操作层,团队按照剧本执行,并实时监控,遇到偏差立即报告。

通过分层决策,AI 建议被限制在明确的边界内。它可以在公司治理流程中被追踪和调整。

风险矩阵:技术风险、商业风险、声誉风险

我使用三维风险矩阵来定义采用门槛。技术维度关注模型漂移、数据质量和可解释性。商业维度检查单点优化是否导致客户流失。声誉维度追踪负面公关和监管关注。

每个格子都标记了评级、缓解措施、风险所有者和触发条件。季度性治理委员会复审,以确保 AI 的效益与风险得到平衡管理。

| 风险类别 | 常见徵兆 | 评级准则 | 缓解措施 | 风险所有者 | 触发条件 | 关联KPI |

|---|---|---|---|---|---|---|

| 技术 | 准确率下滑、数据漂移、解释度不足 | 影响面>20%样本或关键任务 | 回训模型、强化数据稽核、启用可解释工具 | 数据科学主管 | 监控指标连续两周越界 | 模型AUC、延迟、错误率 |

| 商业 | 转换率升高但流失率恶化 | LTV/CAC 低于门槛 | 调节目标函数、改配额、扩充对照组 | 成长与产品负责人 | 客户诉讼或退订达预警值 | LTV、留存、毛利率 |

| 声誉 | 社群负评、媒体关注、主管机构来函 | 高风险议题被主流媒体报道 | 暂停实验、发布说明、启用法遵审查 | 公关与法遵主管 | 负面声量指数超出阈值 | 品牌好感度、投诉件数 |

重点在于将 AI 建议纳入可观测、可回退、可问责的决策框架内。同时,通过 KPI 和风险矩阵来双轨管理,嵌入公司治理的日常。

資料品質與偏誤:為何好模型也會給出錯誤方向

許多團隊認為,只要使用更強大的AI就能解決問題。然而,問題往往出在資料品質和資料治理上。即使演算法非常先進,若輸入資料含有偏差,輸出的結果也會出現偏差。這種情況在模型漂移後,問題會更加嚴重。

樣本偏誤與資料代表性

如果歷史資料僅限於某些學校或特定地區,AI可能會繼承舊有的偏見。這會導致對不利條件的誤判。若樣本代表性不足,建議失效,影響轉化、風控或媒合等功能。

我會先檢查樣本的分佈情況,對族群、通路和時間做細分分析。如果樣本代表性不足,我會增加資料或調整權重。這樣可以避免模型把偶然誤判為常態,保持資料品質的穩定。

回饋迴圈與偏見放大

推薦系統如果只推薦類似內容,初期點擊率可能會上升。但長期來看,會壓縮多樣性,形成單一風格。這種回饋迴圈會使偏誤加劇,難以逆轉,甚至可能導致模型漂移。

我會同時關注多樣性和滿意度指標,加入隨機探索和負樣本。當行為分佈開始偏窄時,我會降低放大權重,幫助AI恢復健康軌道。

在台灣資料治理下的最佳實務

降低偏誤的關鍵在於制度化流程,從資料來源到上線都可追蹤,並符合台灣的個資保護法。

- 資料治理與可追蹤:建立資料血緣、數據字典、標註一致性檢查,缺失與異常處理標準化。

- 偏誤量化:設定Demographic Parity與Equal Opportunity等指標,定期審核樣本分佈與群組落差。

- 法遵與安全:落實目的特定性與資料最小化;敏感資料加密、權限分級、存取稽核。

- 模型監控:同時監看資料漂移與概念漂移,設再訓練門檻,避免無聲的模型漂移侵蝕效能。

透過這些步驟,我能確保AI的效益,同時降低資料品質與偏誤風險。這樣可以讓產品在真實市場中更加穩定。

合規與法規:AI建議不等於合規行為

每次引入AI,我都視為一項法律與治理專案。雖然模型能提出具體步驟,但是否符合法規則需根據企業的合規標準與監管機構的要求來判斷。台灣與歐盟的法規各有其重點,我在制定流程時,始終以最嚴格的標準為準,並保留可解釋性證據鏈,以便隨時接受稽核。

個資保護與GDPR/台灣個資法要點

在台灣,我會先檢查是否已經履行告知義務,然後核實特定目的是否明確。如果目的與實際操作不符,我會立即停止處理,並回應當事人的查詢、更正、刪除與停止處理請求。當涉及跨境資料流動時,我會評估國際傳輸限制,並必要時調整供應鏈。

面對GDPR,我會確立處理的合法性基礎,包括同意、契約或合法利益評估。在高風險情境下,我會啟動DPIA資料保護影響評估,並使用標準合約條款SCCs來管控跨境傳輸。如果涉及自動化決策與分析,我會提供退出與人工介入的管道,以確保AI不會越權。

AI透明度與可解釋性要求

我會向利害關係人公開模型的用途、訓練數據來源、風險與限制。對於高風險場景,我會提供可解釋性輸出,例如特徵貢獻與決策依據,讓非技術人員也能理解影響因素。這不僅是一個技術問題,更是對合規承諾的承諾。

當建議影響價格、人事或信用,我預設需要額外的人審與說明文件。透明設計可以降低爭議與稽核成本,同時增強客戶與監管機關的信任。

內控流程與審計留痕

我建立了政策、權限與變更管理系統;每次模型更新都進行版本控制與風險清單重跑。所有輸入、輸出與人為覆核都留下時間戳與簽核軌跡,形成完整的證據鏈。

- 政策與權限:分層職責、最小權限原則。

- 模型生命週期:資料治理、測試門檻、上線審批。

- 留痕與監控:紀錄查詢、匯出報表、異常告警。

- 定期內外部稽核:對標個資法與GDPR,修補缺口。

透過這套機制,我將AI決策與企業治理緊密結合,確保每一步都可追溯、可說明、可驗證,真正實現合規與可解釋性。

可解釋AI工具:我如何讓團隊看懂「為什麼是這個建議」

我將決策流程分為兩步:「看得懂」與「敢採用」。前者依賴於可解釋AI來提升透明度。後者則依賴於風險溝通來建立信任。當AI提出建議時,我會使用一致的框架呈現:輸出、原因、限制與替代方案。這樣做確保了跨部門的理解。

在專案啟動會上,我會先定義決策變數與商業指標。這樣可以避免把模型分數誤解為因果。這樣的做法讓後續的檢討與迭代更具依據,並讓利害關係人理解模型的限制。

特徵重要度與SHAP值的應用情境

我使用SHAP來解讀個體與整體貢獻。這讓同仁了解單一客戶為何被判定為重要,以及整體樣本的主因。對於樹模型,我使用TreeSHAP;對於深度網路,我則使用Integrated Gradients。當需要時,我會使用LIME來輔助對比。

為了避免過度解讀,我會加入Permutation Importance檢核穩定度。同時,我會使用Partial Dependence Plot來拆解非線性與交互作用。這提高了透明度,並讓產品與法務對AI判斷更有把握。

錯誤案例回溯與模型監控

我建立了一個錯誤案例庫,標記了False Positive與False Negative的高發群體。每月,我會使用模型監控儀表板檢查分佈變化、性能下降與資料新鮮度。同時,我會設定告警門檻。

當異常出現時,我會先檢視資料管道與特徵生成。然後評估是否需要重訓或換模型族。必要時,我會縮小部署範圍,讓風險在可控區間,並記錄調整理由。

將可解釋性融入決策會議

在決策會議中,我採用「模型輸出+解釋+風險與替代方案」的框架。先講清楚核心假設與限制,再展示SHAP摘要圖與關鍵特徵的PDP。最後,給出可執行的選項與風險對應。

為了避免把重要度當成因果,我會提出可行的對照實驗或因果推論設計。並安排小規模灰度發布。這樣既保證了透明度,又提高了效率。

| 工具/方法 | 主要用途 | 模型類型 | 我在會議中的呈現 | 風險控管做法 |

|---|---|---|---|---|

| SHAP / TreeSHAP | 個體與整體貢獻解釋 | 樹模型(XGBoost、LightGBM) | 摘要圖+個體力道條 | 與Permutation Importance交叉驗證 |

| Integrated Gradients | 深度模型特徵歸因 | 深度學習(TensorFlow、PyTorch) | 熱度圖與層級權重說明 | 搭配LIME局部檢核一致性 |

| Permutation Importance | 重要度穩定度檢查 | 通用 | 指標變化表與排序 | 隨機種子與重複實驗 |

| Partial Dependence Plot | 非線性與交互作用 | 通用 | 臨界點與彎折區辨識 | 與業務規則比對邏輯 |

| 模型監控儀表板 | 分佈、性能、資料新鮮度 | 上線中模型 | 月度趨勢與告警 | 滾動重訓與灰度釋出 |

要點:用一致框架說明AI,維持可解釋AI的透明度,同時以嚴謹的模型監控與對照實驗,讓每一步都可追溯、可驗證。

人機協作流程:把AI納入決策而非取代決策

我將AI視為決策助手,而非決策主體。人機協作的核心在於,模型提供決策建議,而我則負責決定是否採用。為了防止權力滥用,我先確定「AI不做什麼」與「必須人簽核的情境」。此外,我還設立了明確的覆核機制,確保決策的邊界。

RACI責任分工:AI作業與人類簽署權限

我使用RACI來劃分每個角色,確保每一步都可追蹤。

- Responsible:資料科學團隊負責模型訓練、效能監控與風險報告,確保AI輸出可重現。

- Accountable:產品或業務負責最終決策與簽核,對結果承擔問責,必要時拒絕自動化建議。

- Consulted:合規與法務提供法規解讀、敏感領域紅線,參與政策調整與條款檢視。

- Informed:內控與稽核獲得決策留痕,定期檢視流程健全度與RACI落實情況。

這套RACI不是紙上談兵。我將權限分級,例行事項可由系統代簽;涉及客戶權益、價格策略或資料使用的變更,則必須由人員簽署並留痕。

雙層審核:自動建議與人類覆核閥值

我設計了雙層審核機制,讓AI先提出建議,再由覆核機制決定是否進一步審查。關鍵在於閥值,包括信心分數、金額門檻與影響範圍。

- 低風險:高信心、低金額、影響範圍小的案例,自動執行並記錄。

- 中風險:任一閥值達臨界,交由值班人員覆核,必要時請合規加入。

- 高風險:多重閥值越界或觸及紅線,直接升級到決策會議,由負責簽署者裁定。

我要求每次覆核都要留下原因碼,以便後續審計與模型優化,避免人治失衡。

設計可撤銷與可申訴的機制

即使最嚴謹的系統也可能出錯,所以我設計了撤銷與申訴流程。

- 撤銷選項:一鍵回滾、黑名單例外、暫停模型路由,確保迅速止損。

- 申訴流程:提供內部通道與外部用戶申訴入口,明定SLA處理時限與回覆責任人。

- 閉環改進:每次撤銷與申訴的結論,都回饋到特徵設計與流程,必要時調整閥值。

我將AI、RACI、覆核機制與申訴流程整合到一套手冊中,讓人機協作既可運作、可查核、可進化。

產品與營運實戰:我如何在專案中落實這套原則

在台灣市場,我運用產品管理原則,將AI融入日常決策過程中。這不僅僅是為了提高效率,更重要的是要確保每一步都符合風險管控與上線流程的要求。這樣做,我們能夠在保持高效的同時,確保每個步驟都符合合規標準。

我採取小步快跑的方法,並且設立明確的停損條件。這樣做不僅能夠確保每一步都能被複製,還能夠有效地學習和改進。

需求定義文件:寫清楚「AI不做什麼」

在產品需求文件中,我新增了兩個重要部分:非目標行為與紅線。非目標行為列出了AI不會處理的情境,例如不依靠敏感資料做決策、不針對未成年人定向、不使用暗黑設計。紅線則明確標示了不可觸碰的資料、族群與場景。

此外,我將成功指標與倫理指標並列。成功指標包括留存率、轉換率與營收,而倫理指標則包括偏誤率、申訴率與可解釋性。這樣做不僅僅是追求「能做」,更重要的是要交代「應該做」。

實驗設計與A/B測試的倫理守則

在設計A/B測試時,我先進行影響評估。這包括清楚告知受試者、採用最小化風險策略,並避免脆弱族群暴露。若涉及關鍵功能,我會啟動DPIA或等效的倫理審查,以降低長尾風險。

每個實驗都設有停損機制與監控閥值。若偏誤、體驗或客服負擔超出警戒值,系統會自動回退到安全版本。這樣做讓A/B測試成為可控的學習工具,而非隱性賭局。

從試點到擴張的風險管控

上線流程遵循三段路徑:Sandbox試點、灰度發布、全面擴張。每一階段都設立明確的門檻,涵蓋性能、偏誤、合規與用戶回饋,並附資安掃描、壓力測試與災難復原計畫。

我成立了變更審議委員會,並維護模型變更日誌。這樣做讓決策過程可追溯。當AI更新策略或數據源時,我先在灰度中驗證,再逐步擴大,保持穩定與可預期。

| 階段 | 目標 | 必備檢核 | 放量條件 |

|---|---|---|---|

| Sandbox試點 | 驗證可行性與安全邊界 | 資安掃描、基本偏誤檢測、可解釋報告 | 性能穩定、無重大客訴、倫理指標合格 |

| 灰度發布 | 測試實際流量下的表現 | 壓力測試、A/B測試停損機制、用戶回饋面板 | KPI達標、偏誤降至閾值內、合規審查通過 |

| 全面擴張 | 穩定運營與持續優化 | 災難復原演練、可用性監控、變更日誌 | 季度審核通過、風險管控得分達標、服務SLO穩定 |

我用可量化的門檻守住節奏,用可溝通的原則贏得信任;讓AI成為助力,而不是黑盒壓力。

- 關鍵做法:PRD先寫「不做什麼」,再談要做什麼。

- 實驗紀律:A/B測試先告知、先設停損、先管暴露。

- 治理節點:三段式上線流程與變更審議同步運作。

溝通策略:向利害關係人說明AI建議的邏輯與限制

我使用清晰且可證實的語言,向各種利害關係人解釋AI如何生成建議,以及它的限制。這一策略以數據為基礎,同時考慮到透明度和用戶權益。這樣做可以確保所有利害關係人在決策過程中保持一致。

對管理層:ROI與風險並陳

首先,我以商業語言來展示AI的ROI。這包括成本節省、效率提升、收入增加以及現金流的改善。接著,我詳細列出可能的風險,如聲譽損害、合規問題、技術債和運營中斷,並給出機率和影響程度。

我提供多種替代方案和成本減少方法。例如,逐步部署、人工審核閥值、模型降級機制以及備援流程。與財務和營運部門合作,建立停損點,以確保投資和風險在董事會層面得到持續監控,同時保持必要的透明度。

對法務與合規:證據鏈與決策留痕

我提供了一整套文件:資料流程圖、處理目的與法源依據、同意機制說明、第三方供應商評估紀錄、模型卡與測試報告、審計追蹤編號。這些文件確保決策過程的可追溯性,所有輸入、輸出和版本都可驗證。

同時,我準備了事件報告SOP和留痕規範,包括資料保留期限、刪除程序和權限管理。對於B2B客戶,我補充了SLA、資料保護附件和安全認證(如ISO 27001),以便利害關係人理解AI運作的邏輯和界限。

對使用者與客戶:透明、可控與退出權

我提供簡單明瞭的隱私聲明和用途說明,伴隨著易於理解的摘要。這樣做讓人能夠理解AI為何會給出特定的建議。同時,我設置了明確的控制選項:關閉個人化、調整追蹤範圍、申請資料存取和刪除,強化用戶權益。

我建立了申訴和聯絡管道,並在產品中提示風險和限制,避免誤用。對於企業客戶,我補充了模型更新頻率、服務可用性承諾和異常通報流程。透過一致的溝通策略,我維持了透明度,建立了信任,促進了負責任的AI使用。

指標與量測:判斷「要不要做」所需的多維度KPI

透過明確的量測框架,我將 AI 建議轉化為可比較的 KPI。首先,明確決策目標。然後,選擇合適的指標與權重。這樣可以同時考慮營收、用戶體驗和風險。同時,我將品牌資產視為長期資本,避免短期操作損害信譽。

財務、體驗、風險三軸指標

三軸指標的並行,讓判斷更為穩健。財務上,我會檢視策略是否有效。體驗方面,追蹤用戶的情緒與行為。風險指標則用於防止模型偏差。當三軸指標不一致時,我會優先檢視資料來源與假設。

| 維度 | 核心KPI | 決策用途 | 觀測頻率 |

|---|---|---|---|

| 財務 | 營收貢獻、CAC、LTV、毛利 | 評估投入產出與單位經濟 | 週更/專案里程碑 |

| 體驗 | NPS、留存率、投訴率、內容多樣性 | 監測信任與互動深度 | 週更/事件觸發 |

| 風險 | 偏誤指標、誤判率、合規事件、數據外洩事故 | 控管法務、聲譽與營運中斷 | 日更/即時警報 |

短期與長期效益的平衡

我採用 Portfolio 思維,分配資源。部分專案追求短期增長,另一部分則強化品牌資產與資料能力。北極星指標保持方向一致,避免因短期轉換率上升而損害用戶信任。

做或不做不僅考慮 ROI,也考慮時間折現與外部性。我會將 AI 成效與留存、推薦、自主搜尋比例等間接指標一起檢視,降低局部最適。

紅線與警戒值的設定

我預先設定不可逾越的紅線,並設計分級警戒。當指標接近門檻時,系統自動降級並啟動人工覆核;若超過紅線,立即下線並啟動事後檢討。

- 紅線:偏誤超過門檻、申訴率突增、資料外洩事件

- 警戒值:誤判率連三週上升、NPS 下滑超過兩個標準差、合規事件未結案

- 處置:降權重、暫停推薦、加設人審、回灌標註資料以修正模型

所有處置與結果都回寫到量測框架,形成可追溯的決策史。這樣做讓下一次評估 AI 建議時,KPI 具有上下文,同時促進流程與模型持續優化。

常見誤區:把AI建議當成命令的代價

團隊常把 AI 當作權威,結果陷入 最佳化陷阱。台灣市場中,數據再如何精美,也需考慮場域脈絡與人類判斷。忽視 文化語境 和 在地化 細節,決策可能偏離使用者真實需求,甚至引發反彈。

過度最佳化導致路徑依賴

追求短期 KPI(如點擊率),內容趨同,導致用戶疲勞。社群貼文被模型推向單一風格,結果觸及先增後跌,形成路徑依賴,壓縮創新空間。

- 我會設多重目標:轉換、留存、品牌信任並重,避免單指標綁架。

- 用探索/利用平衡:設定 multi-armed bandit 的探索率,保留新題材的曝光。

- 每季審視學習率與節奏,防止模型固化。

忽視偏誤造成系統性不公平

資料有盲點時,推薦與定價會放大 系統性偏見。例如廣告投放中,弱勢族群可能被低估價值,持續接收次級內容,法規與公關風險也隨之上升。

- 我進行偏誤審計:檢查族群覆蓋、錯誤率差距與長尾表現。

- 引入人類專家審查:法遵與風險小組共同覆核高影響決策。

- 建立監測門檻:當差異超標即觸發調整與回滾機制。

忽略場域知識與文化語境

把海外模型直接複製到台灣,常因 文化語境 不合而失敗。繁體中文語料、在地節慶、個資法規與社會對隱私的敏感度,都會影響 AI 推薦的實效與信任。

- 我推行在地化測試:以台北、高雄、台中分區 A/B,觀察語氣與類別差異。

- 法規先行:對齊個資法與 NCC 指引,將解釋性與告知納入介面。

- 建立本地語料庫:加入 LINE、Dcard、PTT 的公開語料趨勢作增量訓練。

| 風險面向 | 常見症狀 | 實務對策 | 衡量指標 |

|---|---|---|---|

| 最佳化陷阱 | 內容趨同、用戶疲勞、創新下滑 | 多重目標、探索率調參、週期性模型重訓 | 多樣性指數、重複互動率、創新專案占比 |

| 系統性偏見 | 族群差距放大、申訴升高、品牌負面聲量 | 偏誤審計、專家審查、回滾機制 | 錯誤率差距、申訴率、品牌淨聲量 |

| 在地化不足 | 轉換不穩、節慶檔期失靈、法遵風險 | 在地化語料、區域化 A/B、法務前置檢核 | 區域轉換差、合規稽核通過率、留存提升幅度 |

「工具能導引方向,但價值選擇與情境理解,必須由我來做最後把關。」

我將 AI 視為助理,而非上司。只要把握在地化與風險意識,並持續監控最佳化陷阱與系統性偏見,決策就能又快又穩。

結論

在探討AI的應用過程中,我強調AI能提供「怎麼做」的指導,但最終決定「要不要做」則依賴於個人的價值觀與責任感。為了維護決策主權,我著重於建立清晰的目標、嚴格的資料管理、透明的方法以及符合台灣法律的倫理規範。只有在這些基礎上打好,人機協作才能保持平衡,組織才能建立持久的信任。

在實踐中,我利用風險矩陣來評估技術、商業和聲譽三大類風險,並通過多維度的KPI來衡量財務、體驗和風險。當AI提出可能的路徑時,我會考慮情境和文化背景做出最終決策;若數據不穩定,我則要求數據的可追溯性和可解釋性,以避免誤差擴大。這種方式不僅讓人機協作更加精確,也確保決策主權不被工具所控制。

對於未來,我將持續更新流程,根據國際標準和當地法律調整模型監控和審計機制,並在專案中不斷改進指標和工具。我的目標簡單而明確:讓AI成為可靠、可責任、可持續的決策夥伴,同時增強倫理規範和長期信任,最終將人機協作轉化為可衡量的競爭優勢。

FAQ

為什麼我說AI能告訴我「怎麼做」,卻無法替我決定「要不要做」?

AI主要依賴於機率與模式分析,旨在優化特定目標,如點擊率或轉換率。然而,決定是否採用某一策略,涉及到價值、倫理、法律與風險評估,這些都是人類決策的責任。台灣的個資保護法、金管會規範與醫療法等法律框架,對於AI決策的界定尤為重要。

在台灣導入AI,我首先要注意哪些合規重點?

首先,我會檢視資料的目的、合法性與告知義務,確保符合個資保護法與GDPR的原則。對於高風險的應用,我會進行DPIA或等效評估。同時,我會規劃跨境資料傳輸機制,並建立模型版本管理、輸入輸出記錄與變更控制。

可解釋AI應該怎麼用,才能幫助決策而不是增加雜訊?

我會使用SHAP來展示整體與個體貢獻,結合Permutation Importance與Partial Dependence Plot進行解釋。對於樹模型,我會使用TreeSHAP,而對於深度模型則使用Integrated Gradients或LIME。會議中,我會以「輸出+解釋+風險+替代方案」來呈現,避免混淆相關性與因果關係。

生成式AI(如大型語言模型)與傳統決策支援系統有何分工?

生成式AI主要用於草稿、知識整合與加速,我會注意其可能的幻覺與資料來源不確定性。決策支援系統則負責結構化資料、規則與優化決策,最終由人類審核。這兩者之間的協調,確保了效率與可控性。

我如何在行銷投放中平衡轉換率與品牌信任?

我會設定不接觸未成年人,並避免敏感族群標籤。同時,我會限制頻控與避免使用暗黑設計。即使模型建議更激進的策略,我也會以品牌長期價值與合規為考量,並保留人工審核機制。

動態定價會不會引發公平性爭議?我怎麼設計規則?

我會建立透明的規則,並公開價格因素。避免使用敏感特徵與代理變數,並設置上限與峰時緩衝。所有決策都需符合公平交易法與消費者保護法,並提供申訴與人工審核的渠道。

人資篩選用AI最容易踩到什麼風險?

最大的風險是歧視。為避免此問題,我會移除敏感特徵與代理變數,並檢測差別影響。同時,我會保留人工審核與申訴機制,並遵循相關的法律法規。

我如何界定AI建議的使用邊界?

我會將目標分為可量化與不可量化兩類,採用策略、戰術與操作的分工。使用風險矩陣來評估風險,並定期在治理委員會進行審視。

好的模型也可能給出錯誤的方向。為什麼?

樣本偏差、代表性不足與回饋迴圈都可能影響模型輸出。為此,我會建立資料血緣、數據字典與標註一致性檢查。同時,我會監測資料與概念的漂移,並設置偏差指標。

在台灣,我如何把資料治理做到位?

我會遵循目的特定性與資料最小化原則,強化敏感資料的加密與權限控制。同時,我會導入模型監控與再訓練門檻,並確保與法務、資安、內控同步進行。

我該如何把AI納入決策流程,而不是取代決策?

我會使用RACI來明確分工,並設置雙層審核與信心分數。提供回滾、暫停與黑名單例外機制,並建立內外部申訴與SLA。將回饋導入持續改善中。

產品上線前,我怎麼設計實驗與風險控管?

在PRD中,我會清楚說明「AI不做什麼」與紅線。對於A/B測試,我會遵循告知與最小風險原則。實驗過程中,我會採用Sandbox→灰度→全面擴展的路徑,並設置績效、偏差、合規與用戶回饋門檻。

我如何向管理層與合規單位說清AI的價值與限制?

對管理層,我會同時呈現ROI與風險成本,並提出替代方案。對於法務與合規單位,我會提供資料流程圖、同意機制、第三方評估、模型文件與測試報告,並保留完整的審計證據鏈。

對使用者與客戶,我應該提供哪些透明與控制?

我會提供用途說明、可解釋摘要、退出個人化選項、資料刪除與聯絡申訴管道。對於B2B客戶,我會附上SLA、資料保護附件與安全認證,如ISO 27001。

KPI要怎麼設計才能支持「要不要做」的判斷?

我會建立財務、體驗與風險三軸的KPI,平衡短期與長期目標。設置紅線與警戒值,當觸發門檻時,自動降級或升級人工審核或下線,並將結果回饋給模型。

常見的AI導入誤區有哪些?

三個常見的陷阱是過度最佳化造成路徑依賴、忽視偏差導致系統性不公平、忽略在地文化語境。為避免這些問題,我會使用探索/利用平衡、偏差審計、專家審查與在地化測試。

在半導體、電商、金融、醫療等產業,AI的實際角色是什麼?

AI在這些產業中扮演工具與系統的角色,能夠預測、生成與優化。它作為證據與建議來源,而決策權仍在人類與團隊之間分擔。供應商需提供模型文件與風險說明,企業則需建立監控與審核機制。

我如何確保文章或系統內容由AI生成時不誤導?

我要求來源標註、引用鏈結與時間戳,對關鍵資訊進行二次驗證。避免使用可能引起幻覺的內容,並在溝通中標明AI協作。同時,我會使用人工編輯來確保內容的一致性與可信度。